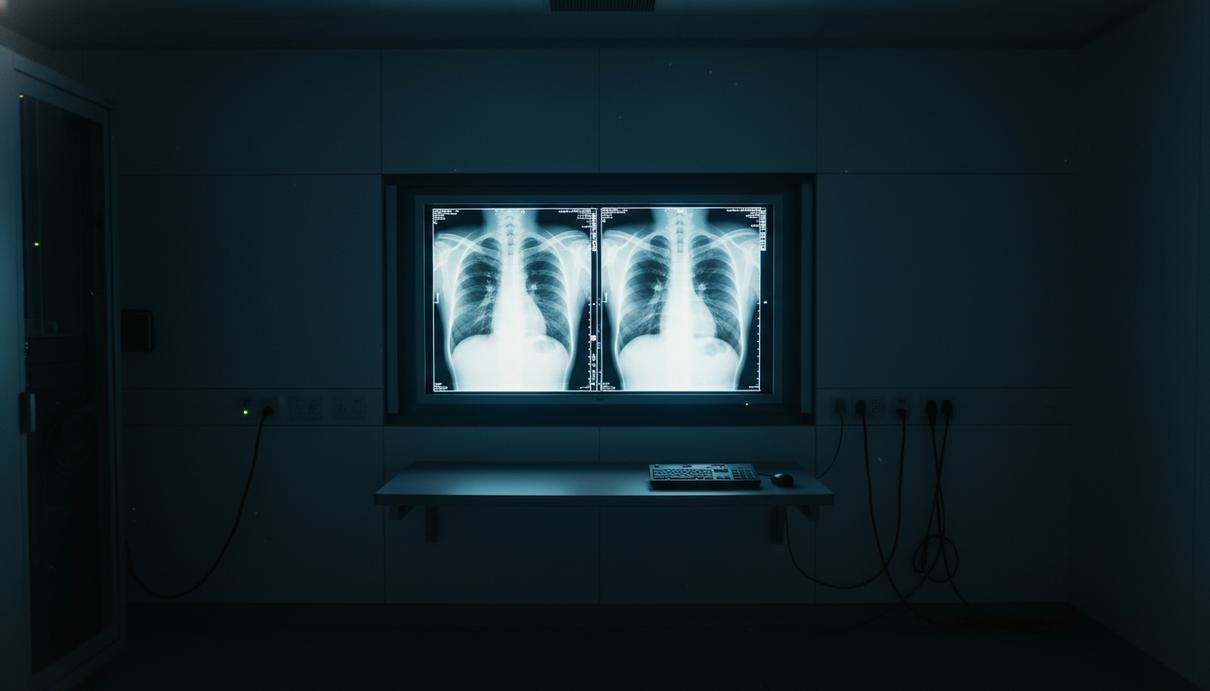

Исследование, опубликованное в журнале Radiology, показало, что опытные рентгенологи и современные мультимодальные языковые модели испытывают серьезные трудности с идентификацией медицинских изображений, созданных при помощи искусственного интеллекта. Специалисты не всегда могут отличить подлинные рентгенограммы от глубоких фейков, что ставит под угрозу безопасность цифровых архивов и достоверность диагностики.

В эксперименте приняли участие 17 врачей из 12 медицинских учреждений США, Франции, Германии, Турции, Великобритании и Объединенных Арабских Эмиратов. Профессиональный стаж участников варьировался от начинающих резидентов до экспертов с сорокалетним опытом. Специалисты из Школы медицины Айкана на горе Синай в Нью-Йорке подготовили для теста 264 снимка, половина из которых была синтезирована нейросетями.

Результаты проверки продемонстрировали, что бдительность врачей напрямую зависит от их информированности о возможных манипуляциях. Если рентгенологам не сообщали о наличии подделок в массиве данных, они успешно распознавали фальшивые снимки лишь в 41% случаев. После предупреждения о присутствии синтетического контента средняя точность идентификации выросла до 75%. При этом личные показатели медиков существенно разнились: точность определения изображений, созданных ChatGPT, колебалась в диапазоне от 58% до 92%.

Сами алгоритмы также оказались несовершенны в вопросах верификации контента. Модели GPT–4o, GPT–5, Gemini 2.5 Pro и Llama 4 Maverick показали точность от 57% до 85%. Примечательно, что даже GPT–4o, использованная для генерации части снимков, не смогла выявить все собственные имитации, хотя и справилась лучше конкурентов. При оценке рентгенограмм грудной клетки, созданных моделью RoentGen от Стэнфордского университета, точность искусственного интеллекта составила от 52% до 89%, в то время как показатели врачей находились в пределах 62–78%.

Авторы работы подчеркивают, что многолетний стаж не гарантирует успеха в поиске подделок – некоторое преимущество имели лишь узкие специалисты в области скелетно-мышечной радиологии. Основными признаками фальсификации оказались избыточная четкость и симметрия. На синтетических снимках кости выглядят слишком гладкими, позвоночник – неестественно прямым, а легочный рисунок и сосудистая сетка – чрезмерно однородными. Переломы на таких изображениях часто выглядят слишком «чистыми» и локализованными на одной стороне кости.

Растущее качество медицинских дипфейков создает новые риски для системы здравоохранения. По мнению исследователей, подобные технологии могут быть использованы для фальсификации страховых случаев и судебных исков или в ходе кибератак на больничные сети для дестабилизации работы клиник. В качестве защитных мер предлагается внедрение невидимых водяных знаков и криптографических подписей, которые будут связывать снимок с конкретным оборудованием и специалистом непосредственно в момент фиксации данных.